Un test né de la frustration d'un chercheur français

En 2019, François Chollet, chercheur français et créateur de la célèbre bibliothèque d'IA Keras, avait un problème avec la façon dont on mesure l'intelligence artificielle. Selon lui, tous les tests existants évaluent ce que l'IA sait déjà, pas sa capacité à apprendre rapidement quelque chose de nouveau. 1

Sa solution ? Créer l'ARC-AGI (Abstraction and Reasoning Corpus), un ensemble d'énigmes visuelles qui testent l'"intelligence fluide" : cette capacité mystérieuse que nous avons tous à résoudre des problèmes inédits avec juste quelques indices. En 2025, une version encore plus corsée, ARC-AGI-2, a vu le jour pour pousser les machines dans leurs derniers retranchements. 2

L'idée derrière ce test est révolutionnaire : plutôt que de demander à une IA de réciter ce qu'elle a appris par cœur, on lui présente des problèmes qu'elle n'a jamais vus. Un peu comme un examen surprise permanent.

"Facile pour l'humain, dur pour l'IA" : le principe qui dérange

Comment ça marche ? Imaginez des petites grilles colorées, comme un Tetris simplifié. On vous montre quelques exemples "avant/après" qui illustrent une règle cachée : par exemple, "tous les carrés bleus deviennent rouges" ou "les formes se reflètent comme dans un miroir". Votre mission : comprendre la règle et l'appliquer à une nouvelle grille. 3

Ce qui rend ce test unique, c'est sa philosophie "Easy for humans, hard for AI" (facile pour l'humain, dur pour la machine). Contrairement aux échecs ou au Go où l'IA nous surpasse désormais grâce à sa puissance de calcul, ici les rôles s'inversent. N'importe qui peut résoudre ces puzzles sans formation particulière, mais nos intelligences artificielles les plus sophistiquées échouent.

La différence avec les autres tests d'IA ? Zéro connaissance préalable requise. Pas besoin de savoir lire, d'avoir étudié l'histoire ou les mathématiques. Seules comptent les capacités cognitives universelles : reconnaître des formes, compter de petits nombres, comprendre l'espace. 4 C'est un test de raisonnement pur, pas de culture générale.

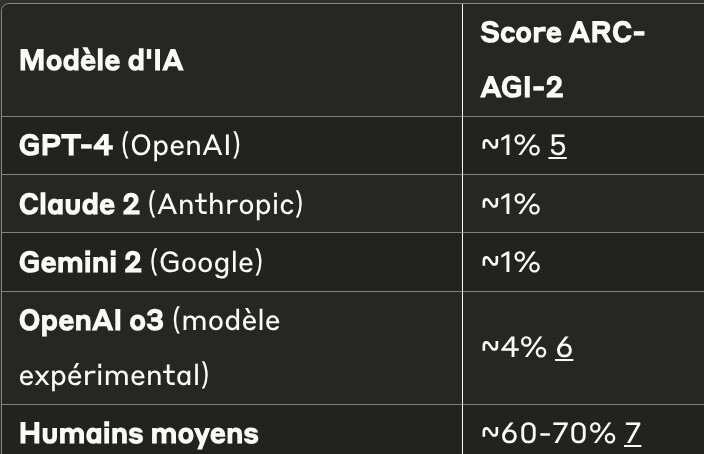

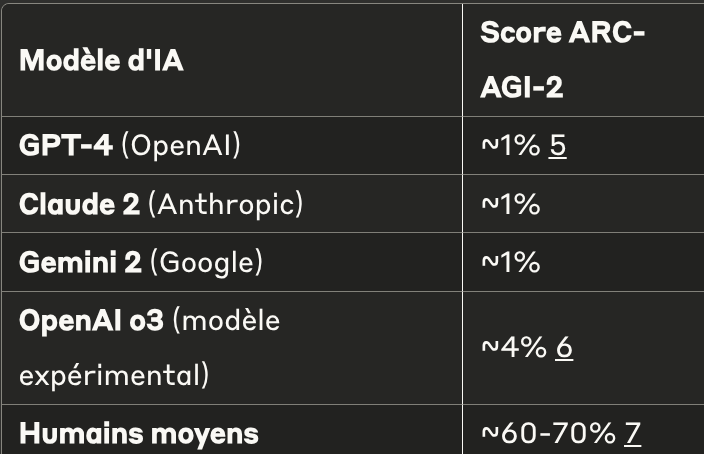

Les résultats sont sans appel et humiliants pour l'industrie de l'IA. Voici les scores approximatifs des modèles les plus avancés en 2025 :

Le massacre : quand nos IA "géniales" obtiennent 1 % !

Oui, vous lisez bien : GPT-4, cette IA qui impressionne par ses analyses littéraires et ses codes informatiques, échoue sur 99% des puzzles qu'un enfant résoudrait en s'amusant.

Le modèle "o3" d'OpenAI, spécialement conçu pour le raisonnement, fait légèrement mieux avec 4%. Mais ce score cache une réalité gênante : pour l'obtenir, OpenAI a dû faire tourner des algorithmes coûtant des centaines de dollars par puzzle en puissance de calcul. 8 Comme si vous utilisiez un supercalculateur pour résoudre un sudoku.

Pendant ce temps, les humains testés résolvent environ 60-70% des puzzles en 2-3 minutes chacun. 9 Chaque énigme jugée "impossible" par les IA trouve preneur chez au moins deux personnes.

Le silence gênant des géants technologiques

Face à ces résultats désastreux, une question se pose : pourquoi OpenAI, Google et les autres ne communiquent-ils pas sur ARC-AGI-2 ?

La réponse est évidente : ces scores font tache dans leur discours marketing. Quand on annonce que l'intelligence artificielle générale (AGI) est "à portée de main" et qu'on vante les performances "surhumaines" de ses modèles, difficile d'expliquer simultanément qu'ils échouent à 99% sur des puzzles d'enfant.

François Chollet l'exprime avec ironie : "Les grands labos disent qu'ils ne s'intéressent pas à ce benchmark parce qu'ils y sont mauvais. Le jour où ils seront bons, ils l'adoreront." 10

Cette situation révèle un problème de fond : reconnaître l'importance d'ARC-AGI-2, c'est admettre que la stratégie actuelle de l'IA ("toujours plus de données, toujours plus gros") atteint ses limites. C'est remettre en question des investissements de milliards d'euros.

Un test parfait ? Les limites d'ARC-AGI-2

Malgré son intérêt indéniable, ARC-AGI-2 n'est pas exempt de critiques :

1. Une vision étroite de l'intelligence : le test se concentre uniquement sur le raisonnement abstrait visuo-spatial. Or l'intelligence humaine comprend bien d'autres facettes : créativité, intelligence émotionnelle, habiletés motrices... Une IA pourrait échouer à ARC-AGI tout en excellent dans des domaines utiles, comme le diagnostic médical ou la conduite autonome.

2. Le piège de la force brute : la première version du test (ARC-AGI-1) avait montré ses limites : près de la moitié des puzzles avaient été résolus par des techniques de force brute - essayer toutes les solutions possibles jusqu'à tomber sur la bonne. 11 ARC-AGI-2 tente de corriger ce défaut, mais la frontière entre "raisonnement intelligent" et "recherche algorithmique sophistiquée" reste floue.

3. L'approche "zéro connaissance" questionnée : peut-on vraiment tester l'intelligence en faisant abstraction de toute connaissance ? Chez l'humain, l'intelligence se manifeste toujours dans un contexte culturel et éducatif. Vouloir tout "stériliser" pour comparer équitablement humains et IA est louable, mais peut-être artificiel.

Ce que révèle vraiment ce test sur l'AGI

Les résultats d'ARC-AGI-2 tempèrent fortement les proclamations optimistes sur l'imminence de l'AGI. Quand Sam Altman, PDG d'OpenAI, déclarait fin 2024 être "confiant de savoir comment construire une AGI" après les succès du modèle o3 sur l'ancienne version du test, ARC-AGI-2 a remis les pendules à l'heure. 12

Ce test illustre parfaitement l'effet "montagne qui grandit au fur et à mesure qu'on avance" dans la quête de l'AGI. À chaque fois qu'on croit avoir gravi le sommet, une nouvelle ascension apparaît derrière.

Plus fondamentalement, ARC-AGI-2 suggère que nos approches actuelles ont des angles morts profonds. La recette du succès de la dernière décennie - "plus de données, plus gros modèles" - semble atteindre ses limites face à la vraie flexibilité cognitive. 13

Pour progresser, il faudra sans doute inventer de nouvelles techniques : intégrer du raisonnement symbolique, développer une mémoire de travail dynamique, hybrider les approches... Un concours doté d'un million de dollars récompense d'ailleurs qui atteindra 85% de réussite à ARC-AGI-2. 14

Mes réflexions critiques

Un révélateur nécessaire, mais partial

ARC-AGI-2 rend un service précieux en révélant les limites de nos IA, souvent masquées par des démonstrations spectaculaires sur des tâches spécifiques. Il nous rappelle que maîtriser parfaitement un domaine ne signifie pas être intelligent de manière générale.

Cependant, je trouve problématique la tendance à présenter ce test comme "le seul benchmark qui mesure l'intelligence générale". 15 C'est réducteur : l'intelligence générale englobe probablement bien plus que la résolution de puzzles abstraits. Un modèle comme GPT-4, malgré son échec à ARC-AGI-2, démontre des capacités de raisonnement, de créativité et de compréhension contextuelle remarquables dans d'autres domaines.

Le piège du "tout ou rien"

Le discours autour d'ARC-AGI-2 tend vers le manichéisme : soit on réussit ce test et on a l'AGI, soit on échoue et on n'a "que" de l'intelligence spécialisée. Cette vision binaire me semble simpliste. L'intelligence, même humaine, fonctionne par domaines et contextes. Personne n'est également doué partout.

Une question de timing

Enfin, il faut garder une perspective historique. Les IA actuelles, malgré leurs échecs à ARC-AGI-2, auraient semblé magiques il y a 20 ans. Les progrès en IA sont souvent non linéaires : stagnation apparente, puis bond soudain. Rien ne garantit qu'une percée conceptuelle ne révolutionnera pas la donne dans les années qui viennent.

Conclusion : un réveil salutaire

ARC-AGI-2 joue un rôle essentiel de garde-fou contre l'hubris technologique. À l'heure où certains annoncent la fin du travail humain et l'obsolescence de notre espèce, ce petit test de puzzles colorés nous rappelle que nos créations restent, sur bien des aspects, étonnamment limitées.

Le test révèle que l'intelligence humaine, dans ses aspects les plus fondamentaux, demeure inégalée. Cette capacité que nous avons à comprendre instantanément des patterns nouveaux, à faire des liens créatifs, à raisonner par analogie, reste un mystère pour nos machines les plus sophistiquées.

Plutôt que de voir ces résultats comme un échec, voyons-y une opportunité : celle de mieux comprendre ce qui nous rend uniquement humains, et peut-être de construire des IA vraiment complémentaires plutôt que simplement imitatives.

En attendant la prochaine révolution de l'IA, profitons-en pour célébrer notre intelligence si naturelle qu'on en oublie sa complexité. Car pour l'instant, même pour colorier correctement quelques petits carrés sur une grille, nous restons les champions incontestés.

Article écrit avec la collaboration de GPT 5 et de Claude Sonnet 4

Sources principales : ARC Prize Foundation, TechCrunch, The Atlantic, arXiv.org

Présentation de la conférence Google I/O 2026

Présentation de la conférence Google I/O 2026